GPT Image 2.0 is hier. Dit is alles wat je ervan moet weten.

Een model dat eerst nadenkt voor het tekent. Nano Banana onttroond met de grootste voorsprong ooit gemeten op Image Arena.

In elke workshop vraag ik wie er weleens een plaatje met AI heeft gemaakt. Tot vorig jaar ging er één hand omhoog, soms twee. Inmiddels is het vaak de helft van de zaal. En altijd komt dan dezelfde klacht. “De tekst in de afbeelding klopt nooit.” Of: “Mijn logo wordt elke keer anders.” Of: “De handen zien er raar uit.”

Die klachten mogen vanaf deze week het archief in. OpenAI lanceerde maandag GPT Image 2.0. De OpenAI-onderzoekers vergelijken de sprong zelf met “van GPT-3 naar GPT-5 in één keer”. Belangrijker nog: dit is het eerste imagemodel dat eerst nadenkt voor het tekent.

En ja, ik hoor je denken… elke image in deze post is gegenereerd met GPT Image 2.0

Twee modi: instant en denkend

Eén demo zegt genoeg. OpenAI liet een foto zien van een berg rijst, duizenden korrels door elkaar. Op één van die korrels staat microscopisch klein “GPT Image 2” gegraveerd, leesbaar als je inzoomt. Het model tekende dat in één prompt. Geen 30 edits, geen Photoshop achteraf, geen upscaling-trucjes. Eén keer vragen, één keer afleveren.

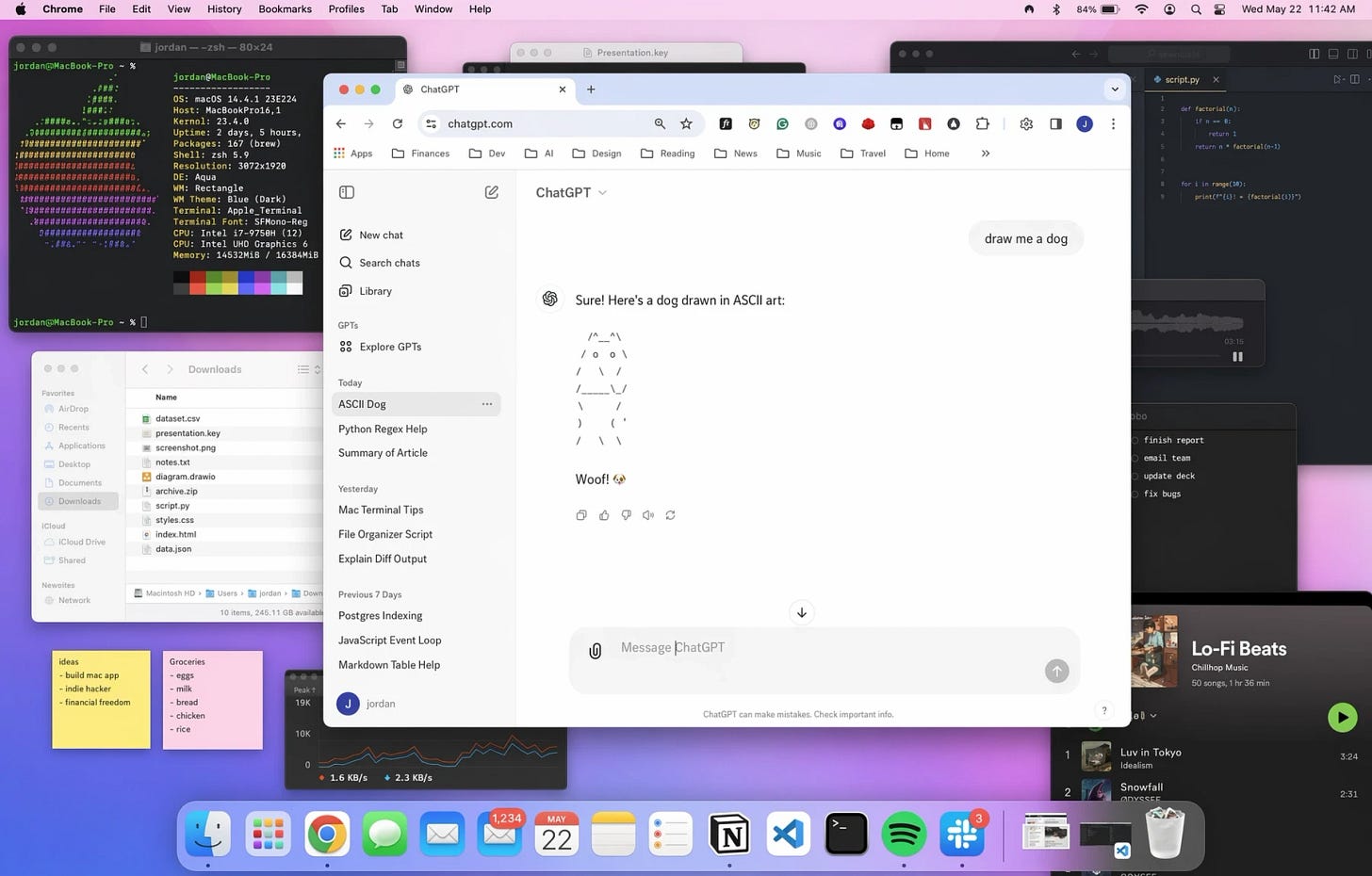

Het model komt in twee smaken. Instant mode is er voor iedereen in ChatGPT, vanaf deze week. Jij typt een prompt, het model tekent. Thinking mode zit achter Plus- en Pro-abonnementen en doet iets anders, het plant eerst. Leest je prompt, stelt zichzelf vragen, zoekt op web als het nodig is, maakt een soort blueprint, en dan pas begint hij met tekenen.

Net als een sous-chef die het recept eerst helemaal doorleest en zijn mise en place voorbereidt voor hij de pan aan zet. Instant mode is de kok die meteen begint koken zodra de bestelling binnenkomt. Voor een omelet prima. Voor een zevengangenmenu is dat geen goed idee.

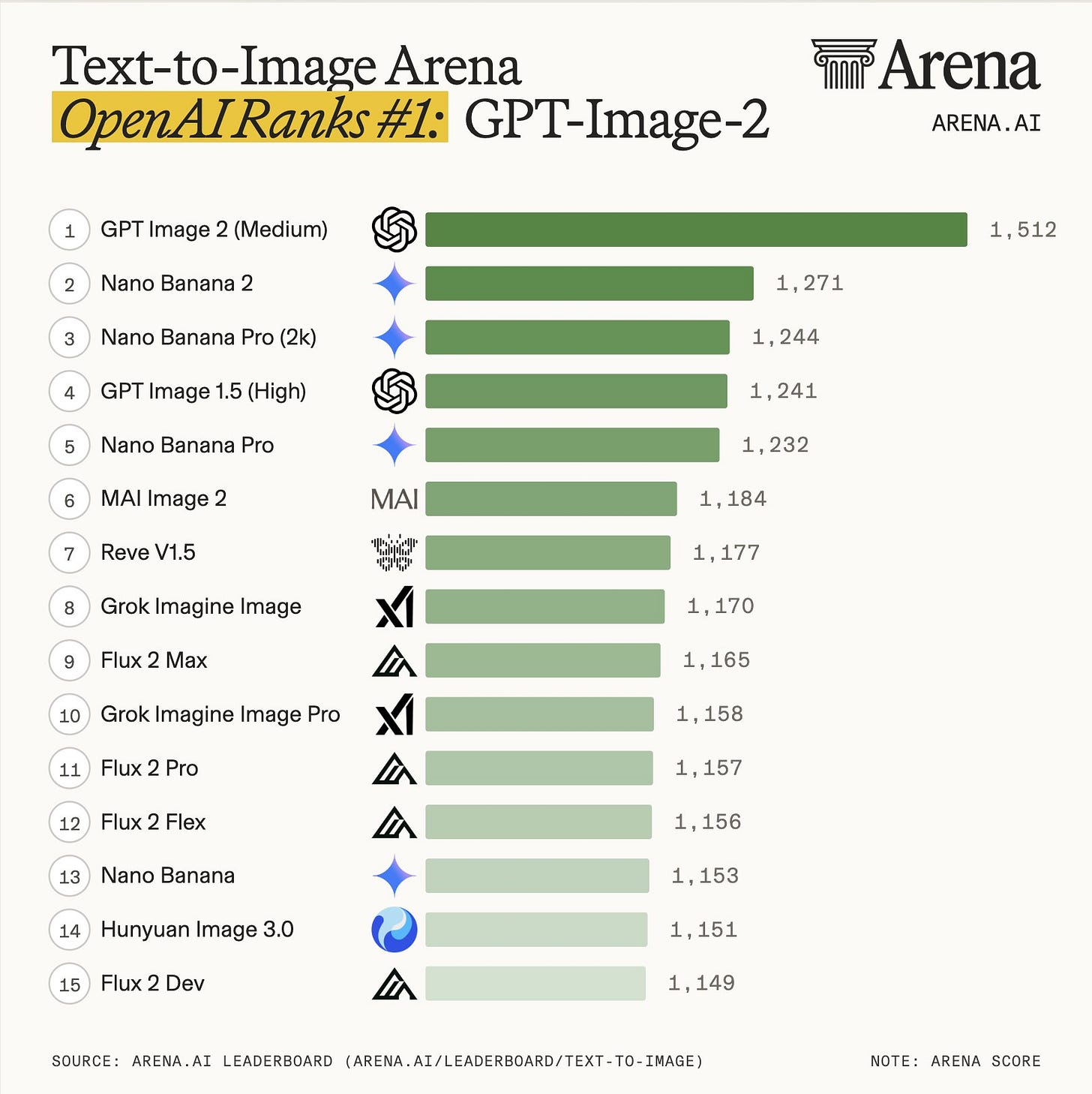

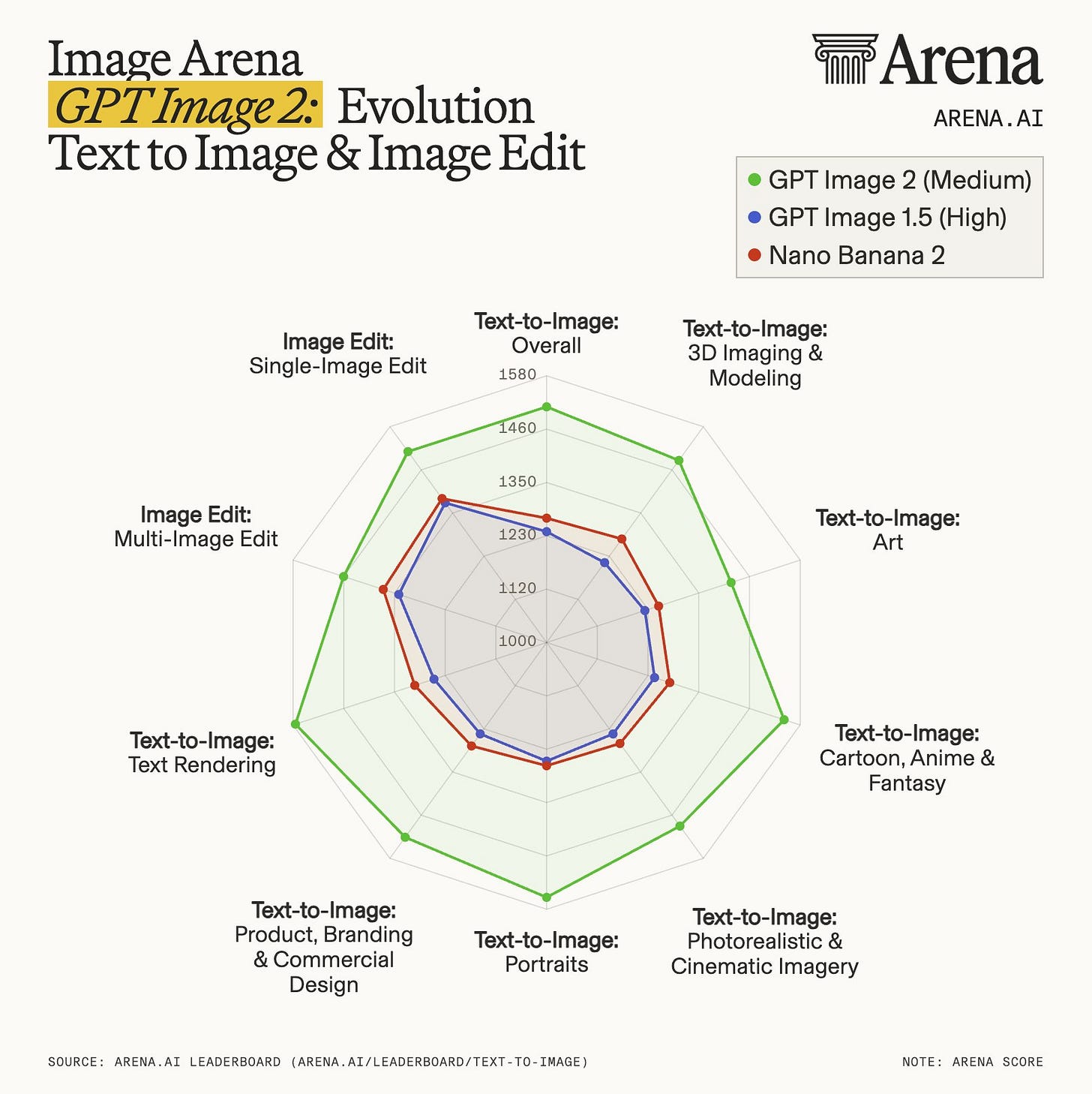

Het verschil in benchmarks is groot. Image Arena is het leaderboard waar AI-imagemodellen blind tegen elkaar worden vergeleken door gebruikers. GPT Image 2 staat daar sinds maandag op #1 in elke categorie. Text-to-Image: 242 ELO-punten voorsprong op Google’s Nano Banana 2. Dat is de grootste voorsprong die Arena ooit heeft gezien. Ter vergelijking, de sprong van GPT-4 naar GPT-5 op het algemene chat-leaderboard was ongeveer 80 punten. Dit is ruim drie keer zoveel, in één update, op één vlak.

GPT Image 2.0 wint breed. Zeven subcategorieen, zeven keer de eerste plek. Fotorealisme +247 punten, text rendering +316, portretten +296, product design +277, cartoon en anime +296, 3D +274, kunst +197. Dat is op alle fronten een ander model dan wat we gewend waren.

GPT Image 2.0 staat sinds 22 april live in ChatGPT voor alle gebruikers. De API volgt begin mei voor ontwikkelaars, met prijzen rond de 0,21 dollar per standaard-plaatje (1024x1024, hoge kwaliteit). Dat is wel zo’n zestig procent meer dan de vorige generatie.

Tekst, samenhang, formaat en realiteit.

Er zit veel in deze release. Ik haal er vier uit die voor jouw werk het meest relevant zijn.

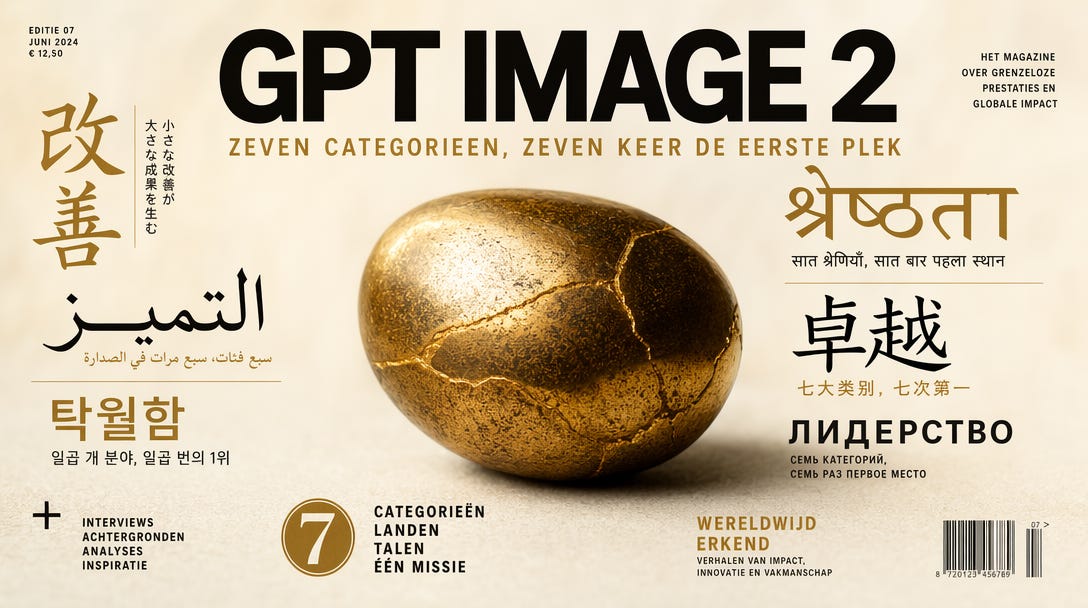

Tekst in plaatjes werkt eindelijk. AI-afbeeldingen hadden een chronisch probleem. Elke tekst in het beeld werd pap. Logo’s werden onleesbaar, typografie was onbetrouwbaar. In een livedemo door OpenAI maakten de onderzoekers een Japanse bakkerij-poster met correcte hiragana en kanji, een Hindi recept met kloppend Devanagari, en een complete magazine-cover met alle bodytext foutloos. Dit is eigenlijk het einde van de “AI-tell” waar grafisch ontwerpers hun vak mee konden verdedigen.

Meerdere plaatjes tegelijk, met samenhang. Tot vorig jaar genereerde je één plaatje per prompt. Wilde je een manga van vier pagina’s? Dan moest je vier keer genereren, hopen dat je personages enigszins hetzelfde bleven, en de rest in Photoshop fixen. GPT Image 2 maakt in één generatie een serie waarin karakters, stijl en verhaal consistent blijven. In de livestream tekende het team een storyboard met dezelfde hoofdpersoon over drie pagina’s. Zelfde gezicht, zelfde kleding, doorlopend verhaal. Voor marketingcampagnes, instructievideos en social carousels.

Formaten zonder beperking. Van 3:1 panoramas tot 1:3 verticals. Een billboard, een Instagram Story, een LinkedIn banner, een A4-flyer met afloopgebied. De API levert tot 4K, in ChatGPT krijg je standaard 2K.

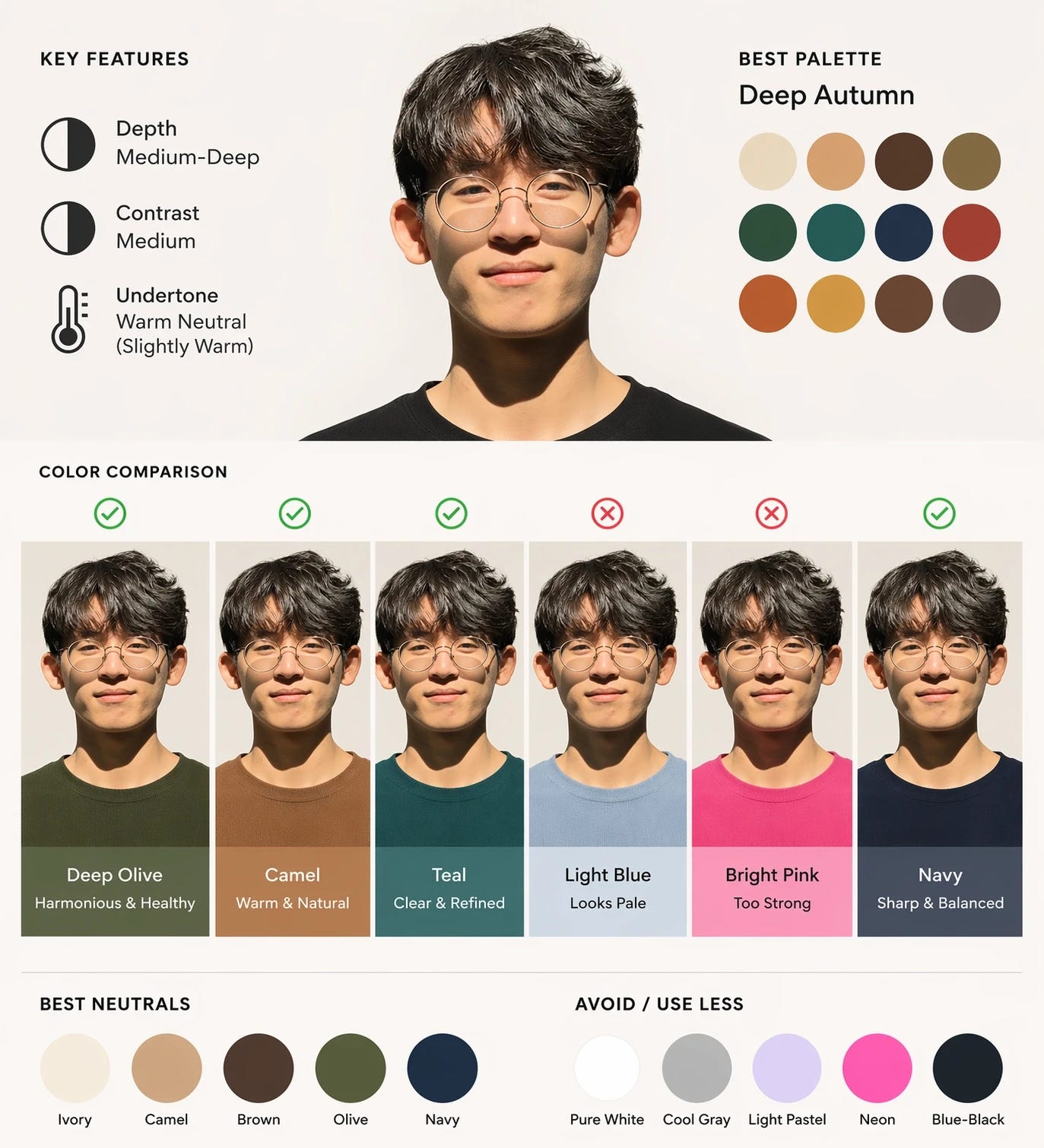

Het model kent de echte wereld. Dit is het deel waar thinking mode zichzelf terugverdient. Vraag GPT Image 2 om een infographic over de laatste AI-videomodellen, en hij zoekt zeven minuten lang op internet naar details die de labs zelf hebben gepubliceerd. Hij vermijdt third-party claims bewust, maakt een plan, en tekent dan pas. In één demo genereerde het model een afbeelding met een QR-code die verwees naar chatgpt.com, en die code werkt ook echt. Scannen gaat gewoon, het model had de code zelf bedacht en getekend in het beeld.

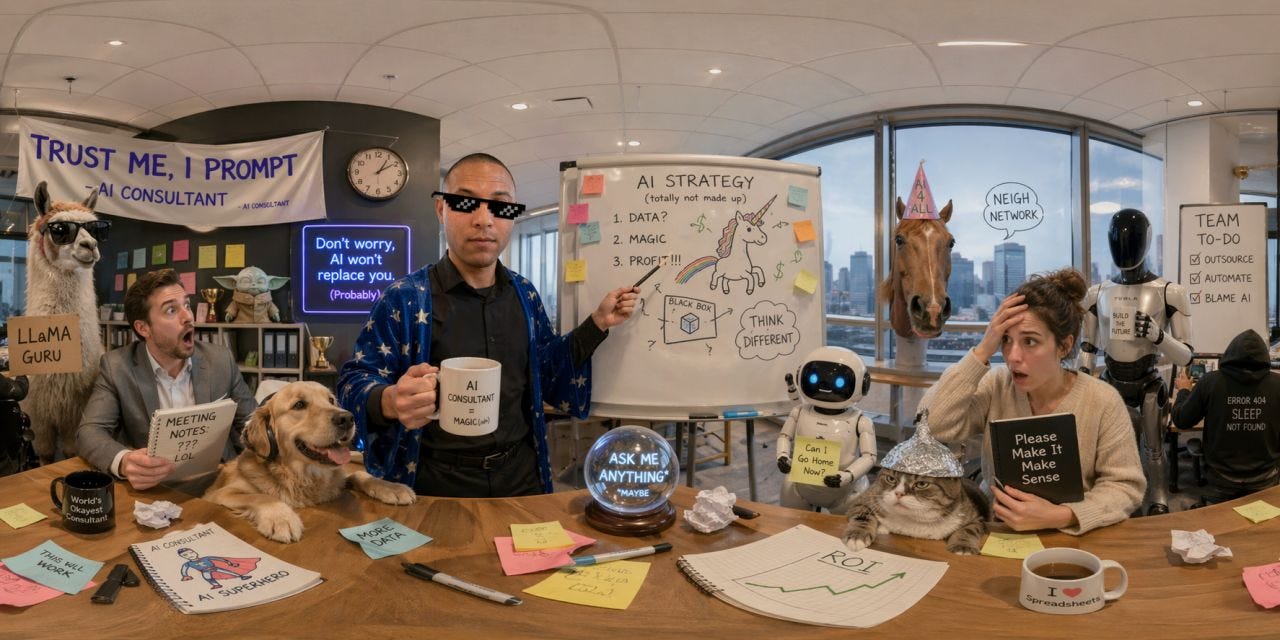

Van consultant tot manager: waar het jou raakt in je werkweek

Ben je consultant of accountmanager? De tijd dat je een deck met generieke stockfoto’s bouwt is voorbij. Je kan tijdens het schrijven van je presentatie direct een infographic genereren met de echte cijfers van de klant, in hun huisstijl, met leesbare tekst. Voor dat sheet waar je anders “grafiek volgt” had gezet, heb je nu in tien seconden een visual.

Ben je marketeer bij een internationaal opererend bedrijf? De taalbarriere in beeldmateriaal is weg. Je maakt in één prompt de Nederlandse, Duitse, Japanse en Arabische variant van een campagne, en de typografie klopt in alle talen. Voor bedrijven als Booking.com, ASML, TomTom of Philips die content in meerdere markten uitrollen, zit hier een kostenvoordeel.

Ben je ondernemer zonder designer? Menukaarten, flyers, event-posters, productfoto’s van nog niet bestaande producten voor A/B-testing. Print-ready assets met correcte bleed marks en trim guides, zonder dat je ooit een designprogramma hebt geopend. Eén van de OpenAI-demo’s was een art deco bladwijzer voor een fictieve boekhandel, compleet met snijlijnen en veiligheidsmarges, kant en klaar voor de drukker.

Ben je manager? Thumbnails voor interne videos, banners voor je Teams-kanaal, visualisaties voor beleidsdocumenten. Dingen die je anders uit een irrelevante stockbibliotheek moest plukken of aan een externe kon uitbesteden. Nu zit dat in dezelfde chat waar je ook je mails dicteert.

Wie de editie van 13 april heeft gelezen: daar liet ik de WAINUT-trailer zien, een cinematische AI-video die we produceren met Seedance 2.0. Afbeeldingen zitten nu in dezelfde kwaliteitslaag. Het gat tussen “idee in je hoofd” en “presenteerbaar resultaat” is voor bijna elk bedrijfsproces kleiner geworden.

Thinking mode, trigger words en de valkuil die je niet mag missen

Een paar dingen uit de praktijk van de eerste dagen.

Schakel thinking mode in als het nodig is. Voor een snelle illustratie hoeft het niet. Voor een infographic met feiten, een storyboard dat samenhang nodig heeft, of een meertalige campagne: zet het aan. Het kost een minuut of twee extra, maar de output komt in één keer goed. Scheelt je vijf keer opnieuw proberen.

Gebruik trigger-woorden. Uit de eerste onafhankelijke tests blijkt dat “photorealism” als expliciet woord een heel ander effect geeft dan “realistic”. Ook “shot on iPhone”, “disposable camera” en “professional photography” sturen het model richting een specifieke look. Zie het als temperature-controls, maar dan in gewone taal.

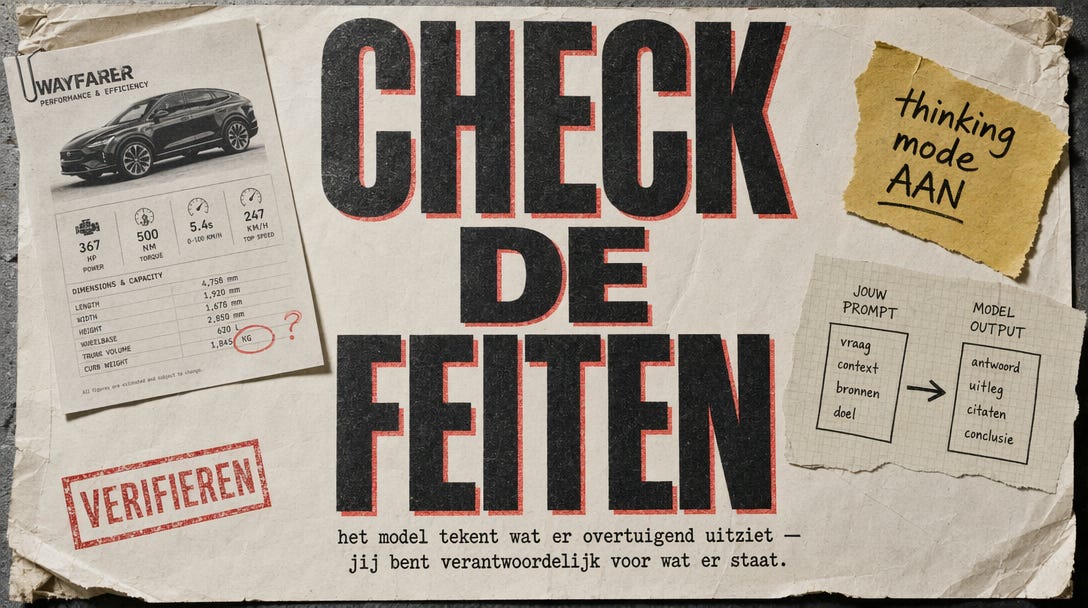

Fact-check wat het model tekent, altijd. Thinking mode kan zoeken, maar zoeken is niet weten. Ik zag een test waar iemand het model een infographic over de Toyota Sienna modellen liet maken, de lay-out er prachtig uit. Maar één uitvoering stond niet in het plaatje, en bij een ander model stond een maanluik genoemd dat niet bestaat. Net als bij tekst tekent het model iets dat er overtuigend uitziet, jij bent eindverantwoordelijk voor wat er staat.

Houd Nano Banana in de toolkit. Het nieuwe model wint niet alles. Voor stijl-klonen (een bestaande illustratie in dezelfde aesthetic voortzetten) en voor puur esthetisch werk zonder tekst doet Nano Banana 2 het op sommige tests nog beter. Maar goed, dat is niet hetzelfde als “GPT Image 2 heeft verloren”. Dus zoals altijd, dit is een extra sterke speler in de toolkit, geen vervanger van wat je al hebt.

Pas op met namaak van andermans werk. Het model kan een screenshot van de Midjourney-website namekn tot op het kleinste detail. Inclusief profielfoto’s, commentaren en gebruikersnamen. Dat is technisch indrukwekkend en juridisch levensgevaarlijk. Deepfakes, UI-recreates van bestaande platforms, look-alike productfoto’s. Dit zijn dingen waar je sinds deze week scherper op moet zijn.

De grootste verandering zit onder al deze features. Twee jaar geleden was een AI-image delen iets wat je voor de lol deed op Twitter. Vandaag staat het in je werkproces. Thinking mode, multi-image coherentie en correcte tekst: dat zijn de drie dingen die beeldgeneratie van speeltje naar werkinstrument verplaatsen. Als jij nog geen enkel visueel proces in je bedrijf hier doorheen laat lopen, loop je vanaf nu achter. En zoals ik in workshops vaak zeg: je zit nog voorin de trein, maar de trein rijdt door.

Probeer het deze week. Neem één visueel dat je normaal gesproken aan een stockbibliotheek of een externe zou uitbesteden. De interne presentatie van vrijdag, de banner voor je nieuwsbrief, de teaser voor je event. Maak het in ChatGPT met thinking mode aan. Kijk wat eruit komt. En dan pas oordeel je.

Ook het vermelden waard

Google lanceert Gemini Deep Research en Deep Research Max Dezelfde maandag dat OpenAI met Image 2.0 kwam, dropte Google Gemini Deep Research en Deep Research Max. Twee varianten, beide draaiend op Gemini 3.1 Pro, die autonoom via MCP proprietary bedrijfsdata combineren met het open web. Max-mode haalt 93,3 procent op de DeepSearchQA-benchmark, tegen 66,1 procent in december. Voor iedereen die nog handmatig markt-research of M&A-analyses doet: dit is geen ChatGPT-met-search meer, dit zijn agents die rapporten afleveren. Nu in public preview via de betaalde Gemini API-tier.

Perplexity Computer komt naar enterprise en Slack Perplexity heeft op z’n eigen developer-conferentie Ask 2026 aangekondigd dat Computer, hun multi-model agent, nu beschikbaar is voor enterprise-klanten. De twist: je typt @computer in een Slack-channel, stelt je vraag, en de agent orkestreert in de achtergrond tot 19 verschillende modellen parallel om de beste match per subtaak te vinden. Microsoft en Salesforce krijgen hiermee een scherpe tweede speler op hun eigen terrein. Voor teams die al in Slack werken: dit is de laagdrempeligste agent-entry die ik deze maand langs heb zien komen.

Meta lanceert Muse Spark als model-fundament voor al hun apps Na het veertien miljard dollar kostende Alexandr Wang-offensief begin dit jaar, heeft Meta deze maand Muse Spark uitgerold. Multimodaal, met zowel een snelle responsmodus als een diepere reasoning-modus, en sub-agents die complexe vragen coordineren. Het model draait straks onder alles: Facebook, Instagram, WhatsApp en de Ray-Ban smart glasses. Relevant detail voor marketeers: de ranking en aanbevelingen op die platforms worden vanaf nu gestuurd door een eigen frontier-model, niet meer door klassieke ML-pipelines.

Lees ook

Zeven grote AI-releases in één week

Het sterkste code-model ter wereld is Chinees, gratis en open source

Vind je dit waardevol? Deel het.

Stuur THE HUMAN LOOP door naar één collega die ook met AI bezig is. Voor elke vriend die zich aanmeldt, krijg je gratis maanden premium: inclusief alle Playbooks.

Concreet:

2 vrienden = 1 maand.

5 vrienden = 3 maanden.

12 vrienden = een half jaar.

Oprecht relaxt dat je alle feiten en nieuwtjes deelt op deze substack, maar ik lees liever je prompt dan je post man. Het ruikt naar ai-slop, de tekst. Ik zie liever jouw eigen kortere, vol met fouten prompt of tekst.