De Nederlandse overheid is nu open source

Eén MCP-server, 24 officiële bronnen, één antwoord met bronvermelding. NL-GOV-MCP, open source door WAINUT.

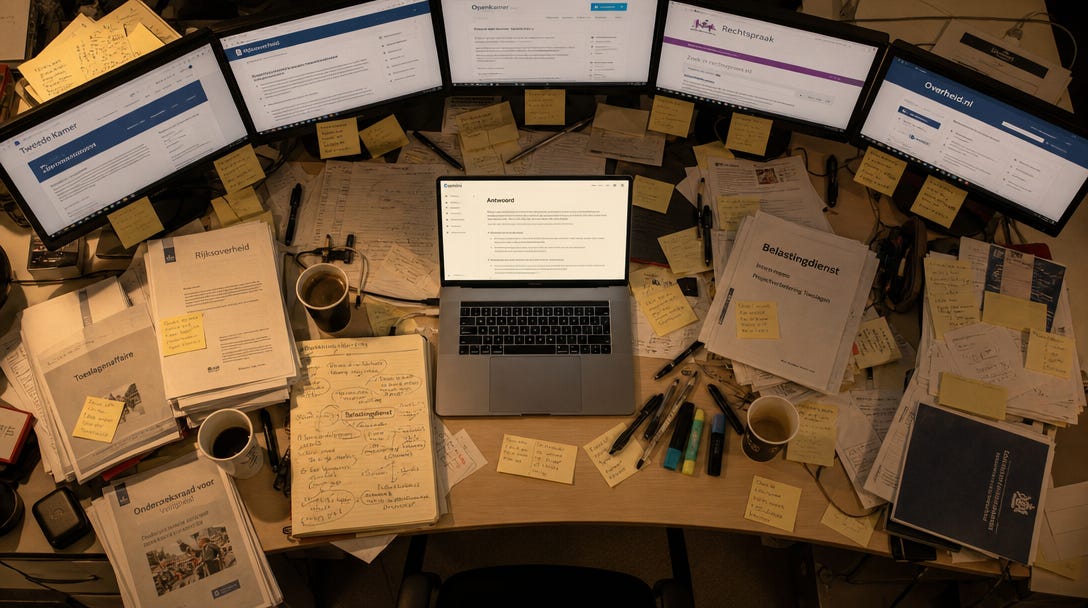

Stel je een beleidsmedewerker voor bij een middelgrote gemeente. Ze zit aan een nieuwe versie van het omgevingsplan en wil weten welke geldende plannen er nog lopen in haar gemeente, wat de bijbehorende rechtspraak over vergelijkbare bezwaren zegt, en wat het ministerie hier dit jaar over heeft besloten. Ze opent de interne chatbot die de afdeling laatst heeft uitgerold. Stelt haar vraag. De chatbot geeft een keurig geformuleerd antwoord dat voor de helft klopt en voor de andere helft uit de mouw geschud is. De data waar ze om vraagt staat openbaar online. Op zes verschillende portalen. De chatbot kan er niet bij.

Dit is waar bijna elke AI-uitrol bij de overheid op vastloopt. En dit is waarom wij NL-GOV-MCP hebben gebouwd, open source onder Apache 2.0, vrij voor iedereen om te installeren.

Een chatbot die het internet niet op mag

Bij veel overheidsorganisaties waar ik over de vloer kom zie ik een patroon. Er staat een chatbot op de website, of er draait Copilot, of er hangt een eigen chat-applicatie boven op een interne LLM. Dat werkt prima zolang de vragen binnen de eigen documentatie blijven. Maar zodra iemand iets vraagt waarvoor externe context nodig is, een wet, een uitspraak, een cijfer van CBS, gaat het mis. Het model verzint, of het geeft een antwoord dat technisch klopt maar drie jaar oud is.

Eigenlijk komt dat door twee dingen die elkaar versterken.

Het eerste is gewoon veiligheid. Veel overheidsorganisaties staan hun AI-assistenten niet toe om het open internet op te gaan, en dat is begrijpelijk: prompt injection, het lekken van gevoelige context, datalekken via webrequests, dat zijn reële risico’s. Dus draait je AI in een afgesloten omgeving zonder browsing en zonder zoekmachine, met niets externs om een antwoord op te baseren.

Het tweede is dat de data die het model wel zou mogen zien, versnipperd is. CBS staat los van de Tweede Kamer. Tweede Kamer praat niet met Rechtspraak. Rijksbegroting weet niet wat DUO publiceert. Wil je als organisatie deze bronnen combineren, dan moet je per bron een eigen API-koppeling bouwen, of, en dat is wat ik bij de meeste teams zie gebeuren, je medewerker opent zelf zes websites in de browser, knipt en plakt de relevante stukken, en plakt ze handmatig in het chatvenster. Dat is de werkelijkheid. Niet schaalbaar, foutgevoelig, en de hele belofte van AI verdampt erin.

Eén interface, 24 deuren

Wat we hebben gebouwd is een Model Context Protocol server. Een MCP-server, kortweg. MCP is een open standaard die Anthropic in november 2024 heeft uitgebracht, en de eenvoudigste manier om het uit te leggen: het is een stekker. Aan de ene kant van die stekker zit een AI-assistent zoals Claude, Copilot of een eigen chat-applicatie. Aan de andere kant zit een gereedschapskist. Wat in die gereedschapskist zit, bepaal je zelf.

NL-GOV-MCP is een gereedschapskist met 24 Nederlandse overheidsbronnen erin. 52 tools in totaal. CBS, Tweede Kamer, Rechtspraak, Officiële Bekendmakingen, Rijksoverheid, Rijksbegroting, DUO, KNMI, PDOK en BAG, Luchtmeetnet, RDW, Rijkswaterstaat, NDW, ORI, het Kadaster, RCE, Eurostat, data.europa.eu, Ruimtelijkeplannen.nl en de DSO Omgevingsdocumenten onder de nieuwe Omgevingswet. Iedere bron is een aparte connector. De gebruiker stelt één vraag in normaal Nederlands of Engels, de router kiest welke bronnen geraadpleegd worden, de queries gaan parallel naar de juiste API’s, en het antwoord komt terug met bronvermelding erbij.

En een ding dat ik er nu meteen bij wil zeggen, omdat dit vaak verwarring oplevert: WAINUT verwerkt geen data en we hosten geen data. Wij hebben geen kopie van CBS, Tweede Kamer of Rechtspraak in huis. Je installeert NL-GOV-MCP lokaal in je eigen omgeving, in je eigen tenant. De vraag van je medewerker en de respons van de bron gaan nooit langs een server van ons. Daarom kunnen we het ook open source maken. Er is geen data-assetje om te beschermen, er is alleen het stukje software dat de bronnen aan elkaar knoopt.

In de praktijk hebben we het inmiddels op meerdere manieren in productie zien lopen. Ikzelf draai het dagelijks in Claude Desktop. Bij een gemeente hebben we het geïntegreerd in OpenWebUI, hun interne chat-applicatie. Het werkt ook met Microsoft Copilot via een MCP-koppeling, en met elk eigen platform dat MCP ondersteunt. Welke tool je kiest, maakt voor de server niet uit.

De vraag die normaal drie dagen kost

Terug naar die beleidsmedewerker uit de intro. Ze heeft een concrete vraag: voor een buurt in haar gemeente komt er een nieuwe woningbouwopgave en ze wil weten welke bestemmingsplannen daar nog gelden, of er recente rechtspraak is over vergelijkbare bezwaarprocedures, hoeveel woningen er sinds 2020 in vergelijkbare wijken zijn opgeleverd volgens CBS, en wat de minister van Volkshuisvesting hier dit jaar over heeft gezegd in de Tweede Kamer.

Zonder NL-GOV-MCP is dat een werkweek. Vier websites openen, zoekqueries verzinnen die per portaal anders werken, resultaten exporteren, in Excel zetten, kruislinks leggen, en hopen dat je niets gemist hebt. Met NL-GOV-MCP typt ze die vraag letterlijk zo in haar interne chat. De router parseert de vraag, herkent de vier domeinen, gaat parallel naar PDOK voor de plannen, Rechtspraak voor de uitspraken, CBS voor de cijfers en Tweede Kamer voor de Kamerstukken. Binnen een minuut krijgt ze één samenhangend antwoord terug.

En dit is het stukje dat ambtenaren bijna altijd verrast als ik het in een demo laat zien. Onder dat antwoord zit een audit trail. Welke bronnen geraadpleegd zijn, met welke zoektermen, op welk moment, naar welke endpoint, alles staat eronder. Voor beleidsanalyse, journalistiek of compliance is dat geen extraatje. Je hebt het simpelweg nodig om AI in productie te durven zetten.

De analogie die ik vaak gebruik bij AI: behandel het als een ijverige stagiair. Een stagiair geeft altijd antwoord, ook als hij het niet weet. Wat je wilt is een stagiair die zegt: “Ik heb het opgezocht bij CBS Statline tabel 83931NED, geraadpleegd op deze datum, en hier is de link.” Niet een stagiair die op gevoel praat. Dat is wat de audit trail doet.

Van iedereen, dus van niemand

Ik kreeg eerder de vraag: waarom heeft de Nederlandse overheid dit niet zelf gebouwd? De data staat er al jaren, de portalen werken, er is een Rijks-API-strategie, er is data.overheid.nl. Waarom moest WAINUT dit doen?

Ik heb zelf bij diverse overheidsorganisaties gewerkt, dus ik weet dit van binnenuit. Deze data is van iedereen, en daarom van niemand. Iedere aanbieder is verantwoordelijk voor zijn eigen stukje en doet dat ook vakkundig, volgens zijn eigen standaarden en releasekalender. Maar het overkoepelende stuk, de laag die de bronnen aan elkaar knoopt, ligt bij geen enkele organisatie als kerntaak. Dat valt tussen wal en schip. Niet omdat mensen het niet zien, maar omdat je er voor over een hoop hoepeltjes heen moet springen: budget, mandaat, politieke aandacht en samenwerking tussen ministeries en uitvoeringsorganisaties die ieder hun eigen agenda hebben.

Wij hadden die last niet. We werken dagelijks met deze bronnen voor onze klanten. We kenden de pijn van onze juridische collega’s, van onze geo-collega’s, van de mensen die rond de Omgevingswet werken. We hadden de markt-kennis en de data-kennis al, en konden gewoon beginnen.

En de keuze om het open source weg te geven? Eerlijk, een paywall voelde gewoon niet juist. De onderliggende data is van iedereen. Wij hebben alleen de combinatie makkelijker gemaakt en dat is geen unieke schat om achter een licentie te verstoppen. Plus, hoe meer organisaties dit gebruiken en eraan bijdragen, hoe beter het wordt. Een bouwbedrijf dat met de Omgevingswet-tools werkt heeft hele andere wensen dan een onderzoeker bij een gemeente die rechtspraak en CBS combineert. Door het open te gooien kunnen die mensen forken, hun eigen lichtgewicht variant maken, of bijdragen aan het origineel. De server wordt er rijker van, en hun toepassing scherper.

Voor wie dit nu is

Voor overheidsorganisaties zelf is dit het meest direct relevant. Ministeries, gemeenten, provincies, waterschappen, uitvoeringsorganisaties, iedereen die intern AI uitrolt en aanloopt tegen die grounding-muur. Voor hen ligt hier een werkende oplossing om dat probleem in één keer weg te halen.

Maar er zijn ook commerciële sectoren die zwaar leunen op overheidsdata. Denk aan juridische teams die continu rechtspraak doorzoeken, aan bouw- en vastgoedpartijen die de Omgevingswet moeten begrijpen, aan onderzoeksbureaus die CBS-cijfers combineren met Eurostat, of aan journalisten die feitencheck doen op officiële bronnen. Het beperkt zich niet tot de publieke sector.

En heeft jouw organisatie helemaal geen raakvlak met overheidsdata? Dan is dit een interessant project om te volgen, niet om vandaag te installeren. Daar zit dan ook nog een bredere les onder.

Eerder schreef ik in mijn playbook over het WAINUT-framework dat de kwaliteit van AI-output staat of valt met de kwaliteit van je grounding. Werk voorbereiden, afbakenen, controleren, daar wordt 80 procent van je resultaat bepaald. De prompt zelf is bijzaak. Wat NL-GOV-MCP doet, is dat principe concreet maken voor de Nederlandse context. Zorgen dat je AI niet praat vanuit half-onthouden trainingsdata, maar vanuit officiële bronnen met een spoor terug naar de bron.

Vrijwel elke organisatie heeft een eigen domein waarvoor je zoiets zou kunnen bouwen. Een MCP-server die jouw productcatalogus, HR-systeem en klantenbestand voor je AI ontsluit. Of een MCP-server die je juridische bibliotheek aanboort, of je onderhoudsdocumentatie. De stekker is hetzelfde, de gereedschapskist verschilt per organisatie. Wij hebben er één gebouwd voor de Nederlandse overheidsdata omdat dat een lege plek was die we elke dag bij klanten zagen. In jouw organisatie ligt waarschijnlijk een vergelijkbare lege plek. Daar over nadenken is misschien wel de belangrijkste actie die je deze week kunt zetten.

Probeer het zelf

De makkelijkste manier om te zien wat het is, is een bezoek aan nlgovmcp.nl. Daar staat een demo waar je zonder account een paar vragen kunt stellen. Hij is rate-limited, dus alleen voor proeven, maar genoeg om gevoel te krijgen.

Wil je zelf aan de slag? De hele codebase staat open op github.com/WAINUTAI/NL-GOV-MCP. Clone, npm install, npm run build, en via een paar regels config hangt hij aan Claude Desktop of een ander MCP-platform. Voor een ontwikkelaar is dat een kwartiertje werk. Apache 2.0 betekent dat je hem mag aanpassen, forken, of in commerciële producten gebruiken zonder licentiekosten.

Zit je in een organisatie met een echte case, dan staat WAINUT klaar voor implementatie, integratie in jullie AI-stack, training van de teams, en het op maat maken van de connector-set die voor jullie relevant is. Dat is wat we doen.

De Nederlandse overheidsdata staat al jaren open en wachtte erop dat iemand er een goede stekker voor maakte. Wij hebben die stekker gemaakt. Hij is nu van iedereen.

Ook het vermelden waard

Vlam-chat: 26.500 rijksambtenaren krijgen dit jaar een eigen AI-chatbot Acht ministeries hebben getekend voor vlam-chat van SSC-ICT, die lokaal in een rijksdatacenter draait op Europese taalmodellen. Er komt ook een vlam-search die overheidsdocumenten doorzoekt met bronvermelding. Het bewijst dat overheid Nederland het probleem inmiddels herkent. Wat het laat liggen, is precies waar NL-GOV-MCP op inspeelt: de bronnen buiten je eigen documenten, parallel doorzocht.

De Nederlandse AI Act implementatiewet ligt nu in openbare consultatie Staatssecretaris Aerdts heeft op 20 april de implementatiewet van de EU AI Act in publieksconsultatie gezet. Tot 1 juni kun je reageren. Nederland kiest voor een hybride model met tien marktautoriteiten in plaats van één centrale toezichthouder. Wie nu AI bij de overheid uitrolt, doet er goed aan de richting alvast te volgen, want vanaf 2 augustus dit jaar gelden de eerste verplichtingen.

MCP groeit door als open standaard, 200+ servers en Dev Summit van 1.200 mensen De roadmap voor 2026 die de MCP-stuurgroep eerder dit jaar publiceerde wordt nu zichtbaar in de praktijk. Een statenloze HTTP-transportvariant zit in review, wat MCP-servers voor het eerst echt horizontaal schaalbaar maakt achter standaard load balancers. Daarnaast komt er een Server Cards-standaard zodat clients capabilities kunnen ontdekken zonder eerst verbinding te maken. MCP is in een jaar tijd van curieus protocol naar industrie-standaard gegaan.

Stanford AI Index 2026: hallucinatieratios variëren van 22 tot 94 procent Het jaarlijkse rapport van Stanford laat zien hoe groot de spreiding tussen modellen nog is op hallucinaties. Het maakt ook duidelijk waarom grounding geen optionele toevoeging is maar de basisinfrastructuur waarop je je AI-strategie hoort te bouwen. Een model dat 22 procent van de tijd hallucineert is niet “bijna goed”, het is een tool die je nooit zonder controle in productie zet.

Lees ook

In negen seconden, drie maanden werk weg

Het WAINUT Framework. Van een goede prompt naar goed resultaat

Vind je dit waardevol? Deel het.

Stuur THE HUMAN LOOP door naar één collega die ook met AI bezig is. Voor elke vriend die zich aanmeldt, krijg je gratis maanden premium: inclusief alle Playbooks.

Concreet:

2 vrienden = 1 maand.

5 vrienden = 3 maanden.

12 vrienden = een half jaar.